NETWORK CONTINUITY MANAGEMENT

UNSERE PRODUKTE & LÖSUNGEN

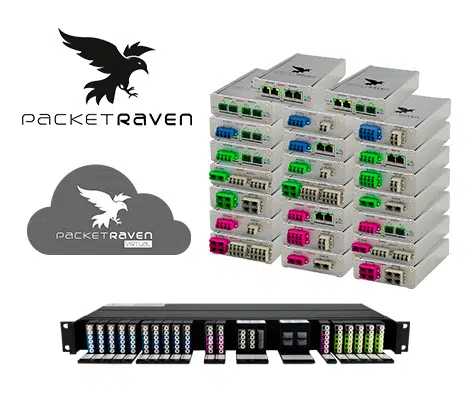

NETZWERK-TAPs | NETZWERK MONITORING

bis 400G

Netzwerk-TAPs sind passive Netzwerkkomponenten für die Analyse Ihrer kritischen Netzwerkdaten. Mithilfe von Netzwerk-TAPs können Sie Ihren gesamten Datenverkehr bequem, zuverlässig und vor allem ohne Beeinträchtigung der aktiven Netzwerkverbindung als Kopie des Netzwerkverkehrs ausleiten und mit entsprechenden Tools auswerten.

Somit erhalten Sie einen vollständigen Überblick über sämtliche Transaktionen und haben über den permanenten Zugriff stets die volle Transparenz über Ihre Netzwerkdaten. Ob modulare oder portable TAPs, speziell gehärtete oder virtuelle TAPs: Wir haben garantiert auch für Ihren Anwendungsfall den richtigen TAP!

PACKET BROKERS | TRAFFIC OPTIMIZATION

bis 400G

Mit einem Network Packet Broker, auch bekannt als Data/Network Monitoring Switch oder Matrix Switch, sind Sie in der Lage, Ihren Analyse- und Monitoring Systemen, sämtliche Datenströme der im Netzwerk verteilten Netzwerk-TAPs oder anderer Datenquellen zuverlässig und aggregiert zur Verfügung zu stellen.

Der Network Packet Broker fungiert hierbei als Bindeglied zwischen dem Zugriffspunkt in Ihrem Netzwerk und beispielsweise Ihrem Security-Tool und unterstützt je nach Ausführung alle gängigen Transceiver-Standards, angefangen von 1 Gigabit SFP-Slots über die weit verbreiteten 10 Gigabit SFP+ Schnittstellen bis hin zu den High-Performance Anschlüssen QSFP-DD, welche Bandbreiten von bis zu 400 Gigabit pro Interface erlauben.

Portables | Packet Capturing

bis 100G

Unsere PacketFalcon-Produkte sind leistungsstarke Aufzeichnungsgeräte für Geschwindigkeiten aller Art und ermöglichen es IT-Organisationen, die Analyse, das Monitoring und die akkurate Aufzeichnung von Datenverkehr ohne Kompromisse zu bewältigen.

PacketFalcon erlaubt den permanenten Zugriff auf 1G-, 10G-, 40G- und 100G-Netzwerkmedien für detaillierte Analysen, inklusive forensischer Analysen vergangener Ereignisse. PacketFalcon unterstützt Sicherheitsteams durch Mitschnitt von Daten an wichtigen Netzwerkpunkten und hält zugleich den Traffic, der durch dieses Datensammeln entstehen kann, so gering wie möglich. Durch Indexierung der Daten und Bereitstellung einfacher und komplexer Filter ermöglicht PacketFalcon den Sicherheitsteams das schnelle Untersuchen und somit Unterbinden von Angriffen.

Modulares | Packet Capturing

bis 100G

PacketGrizzly, eine branchenführende, modulare Lösung zur Paketerfassung und -analyse, ermöglicht Echtzeit- und Post-Event-Analysen in Netzwerken mit Geschwindigkeiten bis zu 100Gbps. PacketGrizzly gibt Netzwerkadministratoren die Möglichkeit, Netzwerk- und Anwendungsleistungsprobleme in 1/10/25/40/100 Gigabit Ethernet, 802.11ac WLAN, VoIP und Video-over-IP-Netzwerken zu identifizieren.

PacketGrizzly bietet sowohl eine leistungsstarke Lösung zur Netzwerkaufzeichnung und Erfassung von bis zu mehreren Petabyte Datenverkehr ohne Paketverlust als auch das preisgekrönte Omnipeek als Software für die Echtzeitanalyse des Live-Netzwerkverkehrs und die forensische Netzwerkanalyse des aufgezeichneten Datenverkehrs.

Advanced| Packet Processing

Der Begriff Advanced Packet Processing umfasst viele verschiedene Funktionen, die allesamt die Analyse und Auswertung von Netzwerkdaten vereinfachen sollen.

Sei es die Maskierung von Nutzdaten in Datenströmen, das Entfernen von Duplikaten oder auch einfaches Packet Slicing.

Mit Advanced Packet Processing können Sie nicht nur die effektive Datenlast auf Ihren Überwachungssystemen reduzieren, sondern haben zusätzlich die Möglichkeit, sensible Inhalte zu schützen oder einfach nur Verbindungsdaten zu erstellen.

WARUM NEOX?

Die NEOX NETWORKS GmbH, mit Sitz in Langen bei Frankfurt am Main, ist ein innovativer Solution Provider und Hersteller von Netzwerklösungen mit Spezialisierung auf die Themenbereiche Network-Visibility, -Monitoring und -Security.

Wir helfen unseren Kunden, die Leistungsfähigkeit ihrer Netzwerküberwachung, Netzwerkforensik, Netzwerkverkehrs-analyse, vollständigen Paketerfassung, gesetzeskonformen Überwachung und Cybersicherheit zu maximieren und sorgen dabei für vollständige Transparenz in Ihrem unternehmensweiten Netzwerk.

Unser Produktportfolio umfasst skalierbare Lösungen wie Full Packet Network Capture Systeme, Netzwerkforensik-Appliances, Netzwerk-TAPs, Network Packet Brokers und Advanced Packet Processing Devices für bis zu 400G schnelle physische, Cloud- oder hybride Netzwerkinfrastrukturen.

IHR ERFOLG – IST UNSERE MOTIVATION

EINIGE UNSERER KUNDEN

MONATLICHER NEWSLETTER

Lassen Sie sich nicht die regelmäßigen Neuigkeiten rund um die NEOX NETWORKS GmbH, ihre Produkte und Hersteller entgehen und abonnieren Sie unseren kostenlosen, monatlichen Newsletter:

NEOX NEWS

Unsere Leistungen:

Wir helfen Ihnen gerne bei diesen und anderen Themen. Sie profitieren dabei von unserer langjährigen Erfahrung und erhalten umgehend professionelle Unterstützung!

- Netzwerkanalyse

- Troubleshooting & Fehleranalyse

- Netzwerk Monitoring (Passiv und Aktiv)

- Netzwerk Performance Analyse NPM

- Application Performance Analyse APM

- Video & VoIP Analyse

- WLAN Analyse

Unsere Kompetenz

40G/100G Hochgeschwindigkeitsnetzwerke sowie BIG Data, Industrie 4.0, Internet der Dinge oder Gigabit WLAN Technologien sind mittlerweile nicht mehr wegzudenken. Höhere Geschwindigkeiten und neue Technologien bringen neue Herausforderung für Netzwerk Administratoren mit sich.

Die Kapazitäten von Security und Netzwerkanalyse Tools sind beschränkt und dennoch ist man aufgrund von Compliance, Security, Forensik oder anderen Gründen gezwungen, Netzwerkdaten für die Analyse zu erfassen.

Hinzu kommt, dass Applikationen sich im WAN oder WLAN Umfeld anders als im lokalen Netzwerk verhalten, daher ist eine verteilte Monitoring Lösung mit der Möglichkeit, Performance- und Verfügbarkeitsmessungen in Echtzeit durchzuführen, eine wichtige Komponente bei der Analyse von geschäftskritischen Anwendungen.

Sie planen, eine neue Anwendung auszurollen, wollen dabei aber sichergehen, dass diese neue Anwendung reibungslos funktioniert und vorhandene geschäftskritische Applikationen nicht negativ beeinträchtigt?

Wir bieten hierfür einen speziellen Service an, mit dem wir Client oder Server Traffic simulieren und die Auswirkungen in Ihrem Netzwerk beobachten können. Dabei werden Antwortzeiten End to End gemessen und das Netzwerk einem Stresstest unterzogen. So erkennen wir viele relevante Details und gewinnen wertvolle Informationen, die wir Ihnen im Ergebnis sehr anschaulich darstellen können.

Haben Sie Probleme mit Antwortzeiten von Applikationen oder erleben sogar Netzwerkausfälle?

Dann helfen wir Ihnen sehr gerne bei der Diagnose und Beseitigung dieser Probleme. Meist kommt die Frage auf, was ist die Ursache? Auch kleine Fehler können in Netzwerken große Auswirkungen hervorrufen. Ein falsch konfigurierter oder schlecht gewarteter DNS Server kann Ihre Netzwerk Geschwindigkeit enorm beeinträchtigen.

Netzwerk-TAPs helfen, diese Daten zu analysieren und geben transparent und ohne Beeinträchtigung der Netzwerkleitung die Daten an den Analyzer weiter.

Netzwerk Glossar

Der Ausdruck TAP ist eine Abkürzung und steht für Test Access Port. Ein TAP stellt einen passiven Zugriffspunkt zum Netzwerk her, womit die über das Kabel übertragenen Netzwerkdaten zu Analysezwecken mitgelesen werden können. TAPs kopieren auch die kritischen Netzwerkpakete mit CRC-Fehler, die bei einer Fehlersuche oder Analyse von großer Bedeutung sind. Mehr erfahren …

Ein Port Aggregation-TAP unterscheidet sich vom normalen TAP darin, dass die ausgekoppelten Voll-Duplex Daten TX & RX auf einen einzelnen Ausgangsport aggregiert werden. So bekommt man die zu analysierenden Daten auf einem Überwachungsport ausgegeben und benötigt keine weiteren Schnittstellen auf dem Monitoring-Gerät. Mehr erfahren …

Regeneration TAPs arbeiten in der Funktionsweise wie reguläre Netzwerk-TAPs, stellen aber die abgegriffenen Daten für die Überwachung mehreren Analysetools gleichzeitig zur Verfügung. Damit können die aus dem Netzwerk abgegriffenen Netzwerkdaten für verschiedene Zwecke von mehreren Monitoring-Tools zeitgleich überwacht werden. Mehr erfahren …